17 апреля 2026, 13:53

Ollama оказался медленным и небезопасным – лучше брать оригинальный llama.cpp

Zetaphor опубликовал в своем блоге “Sleeping robots” резонансный пост. Автор, известный в сообществе локальных LLM, жёстко раскритиковал самый популярный средство для запуска нейросетей на собственном железе – Ollama (стартап, прошедший Y Combinator W21 и привлёкший венчурные деньги). Поводом послужила многолетняя череда проблем: от игнорирования лицензии MIT и замалчивания реального движка llama.cpp до выпуска закрытой десктоп-программы.

Ollama появилась в 2023 году как удобная обёртка над llama.cpp – тем самым C++-движком, который Георгий Герганов набросал за один вечер в марте 2023 года. Именно llama.cpp, с его форматом GGUF и поддержкой более 450 контрибьюторов, сделал возможным запуск LLM на обычных ноутбуках.

Проблема в том, что больше года в README Ollama не было ни слова про llama.cpp, а бинарные сборки не включали требуемое лицензией MIT уведомление об авторских правах. Когда в начале 2024 года открыли issue #3185 с требованием соблюсти лицензию, мейнтейнеры молчали более 400 дней. Позже, под давлением сообщества, один из сооснователей Майкл Чианг добавил в самый низ README одну строчку: “llama.cpp project founded by Georgi Gerganov”.

В середине 2025 года Ollama отказалась от llama.cpp в пользу собственной реализации поверх библиотеки ggml (низкоуровневого тензорного движка). Формальная причина – стабильность для корпоративных клиентов. Фактический итог – возвращение старых багов, которые llama.cpp побеждал годами. Сломалась сопровождение структурированного вывода, полетели vision-модели, посыпались assertion-крэши.

Сам Георгий Герганов заметил в твиттере, что Ollama форкнула GGML и внесла в него плохие изменения. А бенчмарки показали катастрофу: llama.cpp быстрее Ollama в 1,8 раза (161 токен/с против 89) на GPU, а на процессорах разрыв достигает 30–50 процентов. Тест на Qwen-3 Coder 32B продемонстрировал ~70% преимущество llama.cpp по пропускной способности.

Когда DeepSeek выпустил семейство R1 в январе 2025, Ollama выложила в своей библиотеке дистиллированные версии 8B, 32B (на базе Qwen и Llama⚹) просто как “DeepSeek-R1”, отрезав суффикс “-Distill”. Пользователи искренне верили, что запускают 671-миллиардную оригинальную схема на домашнем ПК, а потом жаловались на плохую работу – что нанесло репутационный ущерб DeepSeek. GitHub-issues #8557 и #8698 с просьбой разделить модели закрыли без исправления.

В июле 2025 Ollama выпустила закрытую десктоп-программу для macOS и Windows в приватном репозитории, без лицензии и исходников. Одновременно на сайте кнопка скачивания стояла рядом со ссылкой на GitHub, создавая ложное впечатление, что вы получаете MIT-инструмент. Сообщество забило тревогу, и только через несколько месяцев исходник всё-таки влили в главный репозиторий.

Ollama придумала Modelfile – отдельный конфигурационный файл в стиле Dockerfile, в котором нужно прописывать макет чата, стоп-токены, параметры сэмплирования. Хотя спецификация GGUF требует, чтобы вся эта данные была уже внутри файла модели (пункт № 1: “Не нужно дополнительной информации от пользователя”). В результате, если Ollama не узнает макет из своего хардкоженного списка, она просто ломает структура инструкций, а потребитель вынужден вручную переводить Jinja-шаблон в синтаксис Go. При смене температуры или системного промпта Ollama копирует 30–60 ГБ модели – ведь команда ollama create дублирует весь GGUF.

Автор поста приводит список альтернатив, чем заменить Ollama:

llama.cpp – родной движок с OpenAI-совместимым сервером и веб-интерфейсом и полным контролем.

llama-swap + LiteLLM – оркестрация нескольких моделей.

LM Studio / Jan / Msty – графические приложения.

koboldcpp – ещё одна обёртка с веб-интерфейсом для творческих задач.

ramalama от Red Hat – контейнерный раннер.

⚹ Llama – инициатива компании Meta Platforms Inc., деятельность которой запрещена на территории Российской Федерации.

Читают сейчас

30 минут назад

РТК-ЦОД внедряет защищённые Wi-Fi сети на российском оборудовании в дата-центрах по стране для сотрудников и клиентов

Организация РТК-ЦОД ( входит в ПАО «Ростелеком») начала проект по оснащению своих дата-центров высокоскоростной защищённой сетью Wi-Fi на базе программной платформы «Ростелекома». Работы начались во ф

40 минут назад

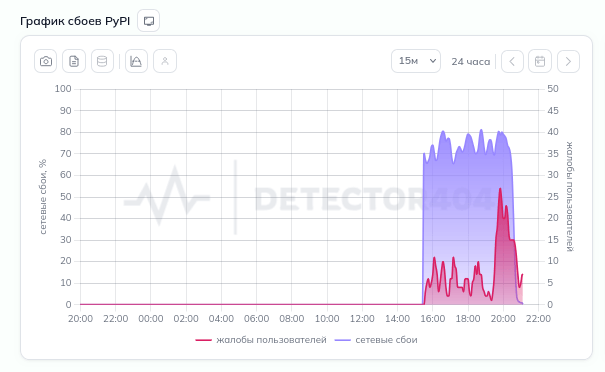

Роскомнадзор: доступ к ресурсам PyPI не ограничивается

По данным издания «Осторожно, новости», Роскомнадзор прокомментировал информацию о возникших проблемах с доступом к ресурсам PyPI (официальному репозиторию пакетов для языка программирования Python) у

1 час назад

В РФ запретили парковать электрокары и гибриды на подземных паркингах

В соответствии с новому своду МЧС о правилах пожарной безопасности, теперь россиянам будут грозить штрафы за парковку электрокаров и гибридных автомобилей на обычных подземных паркингах. Читать далее

1 час назад

Atari купила авторов Crossy Road

Atari купила студию Hipster Whale — авторов Crossy Road. По условиям соглашения, компания сразу заплатит за разработчиков $29,3 млн, из которых $3,3 млн отдаст своими акциями. Ознакомиться далее

1 час назад

Гигантское инфракрасное зеркало телескопа «Роман» готово к запуску

Основной зеркальный диск космического телескопа НАСА имени Нэнси Грейс Роман прошёл заключительную проверку. 20 и 21 мая инженеры Центра космических полётов имени Годдарда НАСА в Гринбелте, штат Мэрил