21 февраля 2026, 20:58

VK внедрила визуально-языковые модели ИИ в поиск своих сервисов

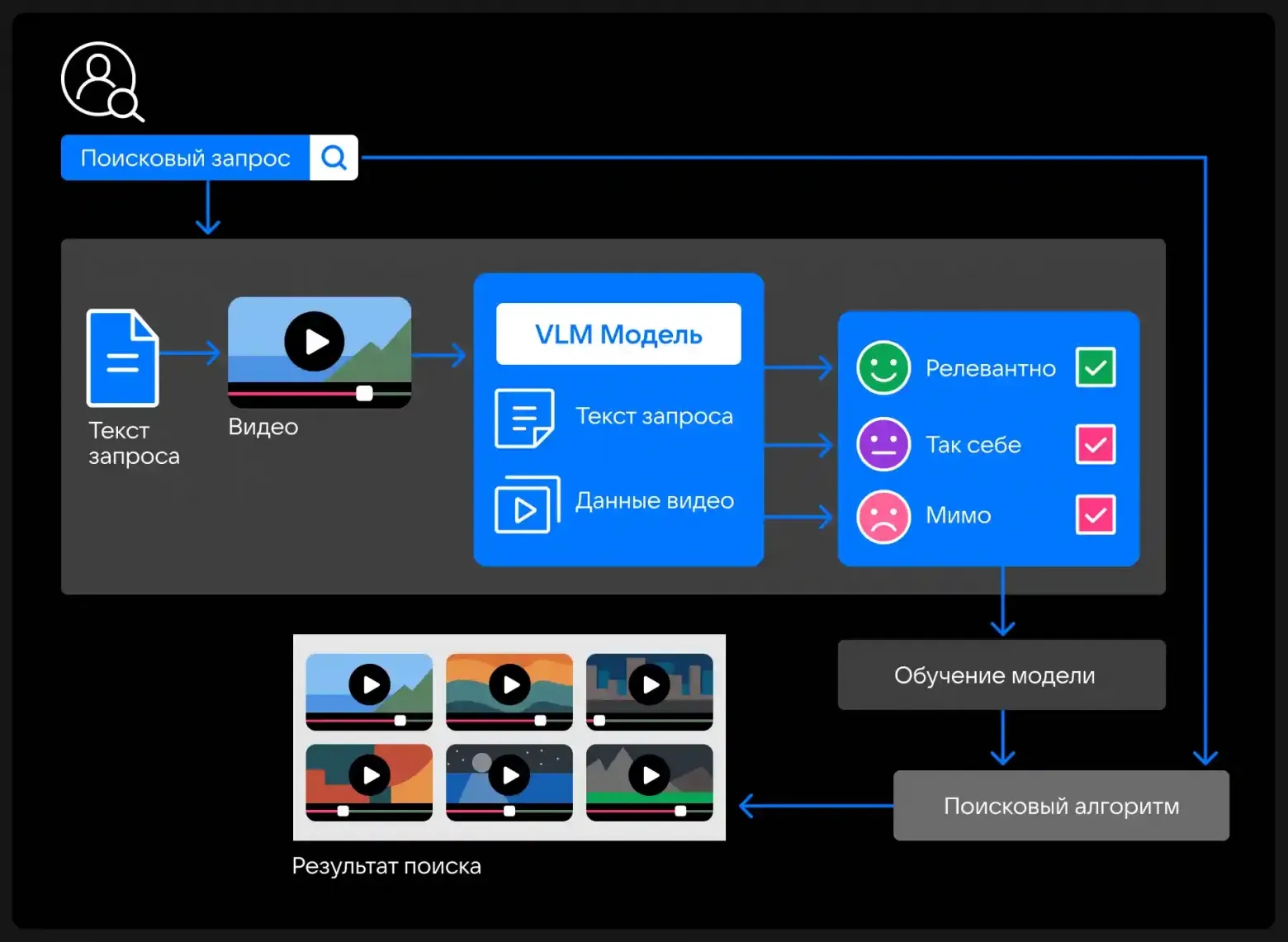

Компания VK начала внедрять в поиск своих продуктов визуально‑языковые модели (VLM). VLM) представляют собой искусственный интеллект, который одновременно анализирует текст, изображения, звук и видеоряд. Технология уже работает в «VK Видео». Она появится в других сервисах компании, где есть поисковые системы.

Модель учитывает название и описание загруженного на платформу контента. Она также анализирует его смысл. Это позволяет точнее отвечать на поисковые запросы пользователей. Новая создание от инженеров AI VK автоматически формирует датасеты. Эти данные о контенте помогают поисковым алгоритмам определять, какое видео подходит к запросу, а какое нет.

С запуском модели в будущем улучшится векторный поиск в продуктах VK. Он основан на семантическом значении запроса. Система будет понимать, что пользователь чаще выбирает видео с определённым стилем монтажа и цветокоррекции. Модель точнее распознает гибридные запросы, где текст и визуальные характеристики комбинируются.

Поисковая выдача станет более персонализированной. Как рассказали в VK, внедрение визуально‑языковых моделей ускорит в пять раз разработку и масштабирование новых технологий. Это поможет развитию и улучшению поиска во всех продуктах VK.

Читают сейчас

20 минут назад

Вышло апдейт RapidRAW 1.5.6 — открытого редактора изображений RAW

В начале июня 2026 года состоялся выпуск обновления открытого мультиплатформенного редактора изображений RapidRAW 1.5.6 с улучшенным экспериментальным релизом для планшетов на Android. Проект предлага

4 часа назад

Выпуск BATorrent 3.0 — легковесного BitTorrent-клиента, созданного на C++, Qt 6 и libtorrent-rasterbar

В начале июня 2026 года состоялся третий мажорный выпуск открытого проекта BATorrent — легковесного BitTorrent‑клиента, созданного на C++, Qt 6 и libtorrent‑rasterbar. Версия BATorrent 1.0 состоялся в

4 часа назад

MAX удалили из App Store

Мессенджер MAX пропал из App Store. Просто в один момент В среду, 3 июня, кто-то из пользователей iOS заметил странное: отечественный мессенджер "Макс" не ищется в App Store. Вообще. Ни через поиск, н

4 часа назад

Версия обновления открытого проекта RustDesk 1.4.7

В начале июня 2026 года состоялся версия открытого мультиплатформеного проекта RustDesk 1.4.7. Это приложение для удалённого рабочего стола, разработанное для самохостинга в качестве альтернативы Team

4 часа назад

️ Anthropic разобрала 832 аккаунта, заблокированных за вредоносную активность с марта 2025 по март 2026 года

⚡️ Anthropic разобрала 832 аккаунта, заблокированных за вредоносную активность с марта 2025 по март 2026 года. ИИ всё чаще используют не для банального фишинга, а для сложных этапов атаки уже внутри в